GO DEEPER

・scikit-learn 全部理解せよ

・Arxiv Vanity - Read academic papers from arXiv as web pages

・arXivTimes

・Browse the State-of-the-Art

・kaggle

・Deep Learning Monitor

・Google Research Blog

・MatConvNet

・御殿場基礎科学研究会

・cvpaper.challenge

・朱鷺の杜Wiki

・IoTニュース

・Accel Brain

・データ分析とインテリジェンス

・HELLO CYBERNETICS

・JetsonHacks

・アジマティクス

・マスクド・アナライズ - note

・マスクド・アナライズのAIベンチャー場外乱闘!

========== Framework==========

・TensorFlow

・TensorFlow Object Detection API

・TensorFlow Dopamine

・Keras

・PyTorch

・Chainer

・ChainerMN

・DarkNet

・Caffe2

・FAIR Detectron

・Theano

・CNTK

・Neural Network Console

========== Data Sets ==========

・THE MNIST DATABASE of handwritten digits

・Fashion-MNIST

・CIFAR

・The Street View House Number(SVHN) Dataset

・Caltech101

・ImageNet

・The PASCAL Visual Object Classes Homepage

・COCO - Common Objects in Context

・Large-scale CelebFaces Attributes (CelebA) Dataset

・The KITTI Vision Benchmark Suite

・WildDash Benchmark

・UCSD Anomaly Detection Dataset

・Motion Human Activity

・animeface-character-dataset

・kill_me_baby_datasets

========== Machine Learning ==========

・pythonでのデータ分析時、死ぬほど調べるTipsをまとめておく。

・機械学習をゼロから1ヶ月間勉強し続けた結果

・ディープラーニングに入門するためのリソース集と学習法(2018年版)

・2018年版もっとも参考になった機械学習系記事ベスト10

・【保存版】Pythonでデータサイエンスするための全体像と、必要な学習項目を初心者向けにまとめてみたよ!

・ひとりでデータ分析ガチ勉 Advent Calendar 2017

・AI技術をぱっと理解する (基礎編)

●Deep Learning実践開発講座(DL4US)公開用リポジトリ

・Coursera - Machine Learning

・CS231n: Convolutional Neural Networks for Visual Recognition | Stanford University

・機械学習を納品するのは、そんなに簡単な話じゃないから気をつけて

・その機械学習プロセス、自動化出来ませんか?

・パターン認識と機械学習の学習

・早水先生 - パターン認識と機械学習入門

・お前は絶望的にプログラミングに向いてないから諦めて刺身にタンポポ乗せる仕事でもやってろ

・頼むからまともなプログラマ目指すなら数学ちゃんと勉強してくれ

・「AI開発ミステリー 〜そして誰も作らなかった〜」とある大手製造業の怖いハナシ

・「神様が来て全てを壊した」 繰り返される仕様変更、本当にあったAIプロジェクトの怖い話

・メテオフォール型開発

・データ分析と他部署の「つなぎ役」がいないと何が起きるのか

・ベイズ最適化の数学

・[Day-23] 機械学習で使う"距離"や"空間"をまとめてみた

・ヒューマンコンピュテーションとクラウドソーシング

・物性理論大学院生の日常〜研究室は解散しました

・The Elements of Statistical Learning : Data Mining, Inference, and Prediction Second Edition

・Statistical Learning with Sparsity : The Lasso and Generalizations

●解説・講義資料 | 神嶌敏弘先生

●東京工業大学 渡辺澄夫先生

・ご注文は機械学習ですか?

・ディープラーニングブログ

・ビジネスに活用するためのAIを学ぶ | Think IT ※誤字・誤記など散見されるため注意して読むこと

【Neural Network】

・ニューラルネットワーク・深層学習研究の歴史

・ニューラルネットワークの動物園:ニューラルネットワーク・アーキテクチャのチートシート(前編)

・ニューラルネットワークの動物園:ニューラルネットワーク・アーキテクチャのチートシート(後編)

・2016年のディープラーニング論文100選

・2017年のディープラーニング論文100選

・DeepLearning研究 2016年のまとめ

・[DL輪読会]Neural Networks as Ordinary Differential Equations

・カオスニューラルネットワーク

・「外部メモリ」理解のためのNeural Turing Machine入門

・深層学習のWasserstein幾何学的解析にむけた取り組み

【初期化】

・Understanding difficulty of training deep feedforward neural networks

・Delving Deep into Rectifiers: Surpassing Human-Level Performance on ImageNet Classification

・Xavierの初期値 Heの初期値の考察

・ニューラルネットにおける変数の初期化について

・dying ReLU について学ぶ 1, 2, 3,

【最適化】

・勾配降下法の最適化アルゴリズムを概観する

・勾配降下法の最適化アルゴリズム

・高卒でもわかる機械学習 (4) 誤差逆伝播法の前置き

・高卒でもわかる機械学習 (5) 誤差逆伝播法 その1

・高卒でもわかる機械学習 (6) 誤差逆伝播法 その2

・誤差逆伝播法(バックプロパゲーション)

・Reconciling modern machine learning and the bias-variance trade-off

・New State of the Art AI Optimizer: Rectified Adam(RAdam). Improve your AI accuracy instantly versus Adam, and why it works.

・Adamの学習係数の分散を考えたRAdamの論文を読んだよ!

【正規化】

●Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift

・Batch Normalizationの理解

【正則化】

●Stochastic Depth

・Deep Networks with Stochastic Depth

●Swapout

・Swapout: Learning an ensemble of deep architectures

●Shake-Shake Regularization

・Shake-Shake Regularization

●ShakeDrop

・ShakeDrop regularization

【損失関数】

・Max-margin Class Imbalanced Learning with Gaussian Affinity

・不均衡データへの決定打となるか!?「Affinity loss」の論文を読む、実装する

・Focal Loss for Dense Object Detection

・RetinanetのFocal Lossに関する覚書 "Focal Loss for Dense Object Detection"

【Data Augmentation】

・Random Erasing Data Augmentation

・Random Erasing Data Augmentationを試す

・Improved Regularization of Convolutional Neural Networks with Cutout

・mixup: Beyond Empirical Risk Minimization

・[Data Augmentation 第1回] mixup 事始め

・[Data Augmentation 第2回] mixup 少量データでの効果測定 (画像編)

・[Data Augmentation 第3回] mixup 少量データでの効果測定 (センサーデータ編)

・中間層でMixup! 〜Manifold Mixup: Better Representations by Interpolating Hidden States〜

●AutoAugment: Learning Augmentation Policies from Data

【Pooling】

●Global Average Pooling

・Network In Network

【可視化】

・Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization

・Grad-CAM(GradCAM)の論文を流し読む

・深層学習は画像のどこを見ている!?CNNで「お好み焼き」と「ピザ」の違いを検証

・Grad-CAM++: Improved Visual Explanations for Deep Convolutional Networks

・最新手法!「Grad-CAM++」のレビューと実装

【Capsule Network】

●Dynamic Routing Between Capsules

【CNN】

・2016年の深層学習を用いた画像認識モデル

・畳み込みニューラルネットワークの最新研究動向(〜2017)

・[サーベイ論文] 畳み込みニューラルネットワークの研究動向

・Res netと派生研究の紹介

・Convolutional Neural Networksのトレンド

・ImageNetによる事前学習について再考した論文 「Rethinking ImageNet Pre-training」を読んだ

●Rethinking ImageNet Pre-Training

●DeCAF: A Deep Convolutional Activation Feature for Generic Visual Recognition

■Adversarial Examples, Adversarial Attack, Adversarial Defense

●Explaining and Harnessing Adversarial Examples

・NIPS'17 Adversarial Learning Competitionに参加しました

■Image Recognition

●AlexNet

・ImageNet Classification with Deep Convolutional Neural Networks

●VGG-16, 19

・Very Deep Convolutional Networks for Large-Scalse Image Recognition

●VGG-S,M,F

・Return of the Devil in the Details: Delving Deep into Convolutional Nets

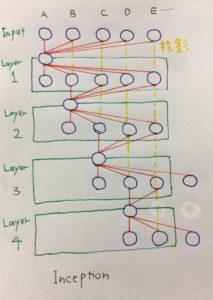

●GoogLeNet

・Going Deeper with Convolutions

References

-[1]Know your meme: We need to go deeper.

-[2]Provable Bounds for Learning Some Deep Representations

-[3]On Two-Dimensional Sparse Matrix Partitioning: Models, Methods, and a Recipe.

-[4]Large Scale Distributed Deep Networks

-[5]Scalable Object Detection using Deep Neural Networks

-[6]Rich feature hierarchies for accurate object detection and semantic segmentation(R-CNN)

-[7]Improving neural networks by preventing co-adaptation of feature detectors

-[8]Some Improvements on Deep Convolutional Neural Network Based Image Classification

-[9]ImageNet Classification with Deep Convolutional Neural Networks (AlexNet)

-[10]Backpropagation Applied to Handwritten Zip Code Recognition

-[11]Gradient-Based Learning Applied to Document Recognition

-[12]Network in Network

-[13]Acceleration of Stochastic Approximation by Averaging

-[14]OverFeat: Integrated Recognition, Localization and Detection using Convolutional Networks

-[15]Robust Object Recognition with Cortex-Like Mechanisms

-[16]Scaling Up Matrix Computations on Shared-Memory Manycore Systems with 1000 CPU Cores

-[17]On the importance of initialization and momentum in deep Learning

-[18]Deep Neural Networks for Object Detection

-[19]DeepPose: Human Pose Estimation via Deep Neural Networks

-[20]Segmentation as Selective Search for Object Recognition

-[21]Visualizing and Understanding Convolutional Networks

・Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning

・[Survey]Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning

●Residual Network (ResNet)

●Deep Residual Learning for Image Recognition

・Residual Network(ResNet)の理解とチューニングのベストプラクティス

●WideResNet

・Wide Residual Networks

●PyramidNet

・Deep Pyramid Residual Networks

●ResNeXt

・Aggregated Residual Transformations for Deep Neural Networks

●RoR

・Residual Networks of Residual Networks: Multilevel Residual Networks

●Xception

・Xception: Deep Learning with Depthwise Separable Convolutions

・[DL輪読会]Xception: Deep Learning with Depthwise Separable Convolutions

●FractalNet

・FractalNet: Ultra-Deep Neural Networks without Residual

●DenseNet

・Densely Connected Convolutional Networks

●SqueezeNet

・SqueezeNet: AlexNet-level accuracy with 50x fewer parameters and <0.5MBmodel size

●MobileNet

・MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications

●SENet

・Squeeze-and-Excitation Networks

●NASNet

・Leaning Transferable Architectures for Scalable Image Recognition

References

-[70]Neural Architecture Search with Reinforcement Learning

・Exploring Randomly Wired Neural Networks for Image Recognition

●AutoML

・Neural Architecture Search with Reinforcement Learning

・Large-Scale Evolution of Image Classifier

■Object Detection

●TensorFlow Object Detection API

●Detectron

●物体検出についての歴史のまとめ

●Deep Learningによる一般物体認識の手法の把握と実利用のためのまとめ

・Object Localization and Detection

・Object Detection in 20 Years: A Survey

・Deep Learning for Generic Object Detection: A Survey

・Recent Advances in Deep Learning for Object Detection

●R-CNN

・Rich feature hierarchies for accurate object detection and semantic segmentation

・EdgeBoxes: Locating Object Proposals from Edges

●Fast R-CNN

・Fast R-CNN

●Faster R-CNN

・Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks

●Single Shot Multibox Detector

・SSD: Single Shot MultiBox Detector

●FPN

・Feature Pyramid Networks for Object Detection

●RetinaNet

・Focal Loss for Dense Object Detection

・[DL輪読会]Focal Loss for Dense Object Detection

●M2Det

・M2Det: A Single-Shot Object Detection based on Multi-Level Feature Pyramid Network

・[DL輪読会]M2Det: A Single-Shot Object Detection based on Multi-Level Feature Pyramid Network

■Semantic Segmentation

・ディープラーニングにおけるセマンティックセグメンテーションのガイド2017年版

・Semantic Segmentation of Point Clouds using Deep Learning

・Large-scale Point Cloud Semantic Segmentation with Superpoint Graphs

・SEGCloud: Semantic Segmentation of 3D Point Clouds

・Unstructured point cloud semantic labeling using deep segmentation networks

●FCN

・Fully Convolutional Networks for Semantic Segmentation

●U-Net

・U-Net: Convolutional Networks for Biomedical Image Segmentation

●Mask R-CNN

・Mask R-CNN

■CNN-SLAM

・CNN-SLAM: Real-Time Dense Monocular SLAM

・第41回関東CV勉強会 CNN-SLAM

■Super Resolution

・waifu2x

・トップ学会採択論文にみる、超解像度ディープラーニング技術のまとめ

■Point Cloud

・三次元点群を取り扱うニューラルネットワークのサーベイ

・三次元点群を取り扱うニューラルネットワークのサーベイ Ver.2

【RNN】

・わかるLSTM 〜 最近の動向と共に

・LSTMネットワークの概要

・人工知能時代の音楽制作への招待 - Google Magenta 解説&体験ハンズオン (自習編)

【Attention】

・Residual Attention Network for Image Classification

・Attention Branch Network: Learning of Attention Mechanism for Visual Explanation

・Attention Branch Networkによる一貫学習・強化学習におけるアテンションの獲得

【GAN】

・Generative Adversarial Networksの基礎と応用

・はじめてのGAN

・何をしたいかで有名どころのGANの種類、派生を整理

・From GAN to WGAN

・正則化問題における敵対的生成ネットワーク(GANs)と敵対的自己符号化器(AAEs)のネットワーク構造

・Open Questions about Generative Adversarial Networks - What we’d like to find out about GANs that we don’t know yet.

・GANと損失関数の計算についてまとめた

・GANを学びたいけれど、価値観数の数式に困惑している人へ

・Geometry Score 〜GANの性能評価〜

・High-Resolution Image Synthesis and Semantic Manipulation with Conditional GANs

・Everybody Dance Now

・GANによるダンス動画生成「Everybody Dance Now」が凄まじい

・2018/9 GAN Related Works CVPR 2018 & Selective Works in ICML and NIPS

・HoloGAN: Unsupervised learning of 3D representations from natural images

・【論文読み】GANを利用した異常検知まとめ

・Deep Learningを用いた教師なし画像検査の論文調査

・Pros and Cons of GAN Evaluation Measure

・[DL輪読会]Flow-based Deep Generative Models

●MakeGirlsMoe

・Create Anime Characters with A.I. !

・Wasserstein Divergence for GANs

●Vanilla-GAN

・Generative Adversarial Nets

●Deep Convolutional GAN

・Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks

●Wasserstein GAN

・Wasserstein GAN

・Towards Principled Methods for Training Generative Adversarial Networks

・[DL輪読会]Towards Principled Methods for Training Generative Adversarial Networks

・[DL輪読会]Wasserstein GAN / Towards Principled Methods for Training Generative Adversarial Networks

・Read-through: Wasserstein GAN

・Wasserstein GAN and the Kantorovich-Rubinstein Duality

・Wasserstein GAN と Kantorovich-Rubinstein双対性

●WGAN-GP

・Improved Training of Wasserstein GANs

・[DL輪読会]Improved Training of Wasserstein GANs

●Inception Score

・Improved Techniques for Training GANs

・A Note on the Inception Score

●Frechet Inception Distance(FID)

・GANs Trained by a Two Time-Scale Update Rule Converge to a Local Nash Equilibrium

●Cramer Distance

・The Caramer Distance as a Solution to Biased Wasserstein Gradients

●Maximum Mean Discrepancy(MMD)

・On gradient regularizers for MMD GANs

・DEMYSTIFYING MMD GANs

●AnoGAN

・Unsupervised Anomaly Detection with Generative Adversarial Networks to Guide Marker Discovery

・AnoGANの論文を読んでMNISTの異常検知をしてみた

・DLゼミ Unsupervised Anomaly Detection with Generative Adversarial Networks to Guide Marker Discovery

●Adversarially Learned One-Class Classifier for Novelty Detection

・ディープラーニングによる異常検知手法ALOCCを実装した

・GitHub

●AVID: Adversarial Visual Irregularity Detection

・[DL輪読会]AVID: Adversarial Visual Irregularity Detection

・[DL Hacks]AVID: Adversarial Visual Irregularity Detection

■Natural Language Processing

・Stanford NLP - GitHub

・4. 自動評価尺度 BLEU

・DeepLearningにおける会話モデル: Seq2SeqからVHREDまで

・seq2seqで長い文の学習をうまくやるためのAttention Mechanismについて

・State-of-the-Artを達成したニューラル機械翻訳2017年

・Word Mover's Distanceを使って文の距離を計算する

●Understanding Back-Translation at Scale

●Attention is All You Need

・作って理解する Transformer / Attention

●BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding

・汎用言語モデルBERTを日本語で動かす(PyTorch)

・汎用言語モデルBERTの内部動作を解明してみる

・[翻訳]BERTで自然言語AIをはじめる(github上のREADMEの翻訳)

■Anomaly Detection

・Anomaly Detection: A Survey

・Deep Learning for Anomaly Detection: A Survey

・【異常検知】Deep Learning for Anomaly Detection: A Surveyを読んだ(前編)

・【異常検知】Deep Learning for Anomaly Detection: A Surveyを読んだ(後編)

・Deep Semi-Supervised Anomaly Detection

・[DL輪読会]Deep Anomaly Detection Using Geometric Transformations

【Deep Q-Network】

【Deep Boltzmann Machines】

【SVM】

・サポートベクターマシン - 産総研 赤穂先生

・SVM、ニューラルネットなどに共通する分類問題における考え方 - Hello Cybernetics

・サポートベクターマシンの概要

【カーネル法】

・カーネル法入門 1.カーネル法へのイントロダクション - 統数研 福水先生

【アンサンブル学習】

・アンサンブル学習(Ensemble learning)とバスケット分析(basket analysis)

・XGBoost論文を丁寧に解説する(1)

・XGBoost論文を丁寧に解説する(2): ShrinkageとSubsampling

【強化学習】

・ゼロからDeepまで学ぶ強化学習

・深層強化学習の最前線 - Speaker Deck December 19, 2018

【転移学習】

・Improving predictive inference under covariate shift by weighting the log-likelifood function

【情報幾何学】

・情報幾何で見る機械学習 -産総研 赤穂先生

・情報幾何と機械学習 -産総研 赤穂先生

・情報幾何への入門と応用

・情報幾何学と幾何学的力学系理論のための融合ノート

・情報幾何学と統計多様体の幾何学

【Topological Data Analysis・位相的データ解析】

・移送と集合

・位相的データ解析の基礎と応用

・位相的データ解析の現在

・Persistence Weighed Gaussian Kernel for Topological Data Analysis

・パーシステンスホモロジーと機械学習

・パーシステンス図の逆問題

・トポロジカルデータアナリシスと時系列データ解析への応用

・Julien Tierny - Home Page

・Julien Tierny - Topological Data Analysis Class

・TTK - the Topology ToolKit

・HomCloud

【その他】

・先端技術とメディア表現1 #FTMA15 グループワークの進め方、サーベイのやり方

・状態空間モデルの考え方・使い方

・iOSDC Japan 2018「圏論とSwiftへの応用」発表スライドメモ

・世界に1つだけの三角形の組 -抽象的現代数学を駆使して素朴な定理の証明に成功-

・プリキュアで学ぶ劣モジュラ関数 - むしゃくしゃしてやった、今は反省している日記

・初心者が学ぶP, NP, NP困難(Hard), NP完全(Complete)とは (わかりやすく解説) - MotoJapan's Tech-Memo

・文筆劇場

【教科書】

下記4冊を買えばOK

|

![]()

|

![]()

|

![]()

|

![]()

・NVIDIA関連

-[0]さくら、TITAN X搭載GPUサーバサービスの新規提供を一時停止 NVIDIAのライセンス条件変更で - ITmedia NEWS

-[1]NVIDIA GeForceソフトウェアお客様使用ライセンス

-[2]NVIDIA、過去に国立研究機関へのGeForce導入妨害の疑い -WirelessWire News

-[3]NVIDIAが規約変更によりGeForceのデータセンター利用を制限。大学などの研究活動にも大ブレーキ - WirelessWire News

-[4]みんな、これからは深層学習にはGeForceではなくRadeonを使おう - shi3zの長文日記

========== Computational Fluid Dynamics ==========

【界面追跡】

【界面捕獲】

【MPS】

【SPH】

【Lattice Boltzmann】

【Non-Newtonian Fluid】

公開日:

最終更新日:2020/12/28